Μεγέθυνση κειμένου

Η OpenAI αποκάλυψε λεπτομέρειες σχετικά με τις δοκιμές ασφάλειας μοντέλων τεχνητής νοημοσύνης - συμπεριλαμβανομένων των ανησυχιών για τη νέα ανθρωπόμορφη διεπαφή της

Στα τέλη Ιουλίου, η OpenAI άρχισε να κυκλοφορεί μια παράξενη ανθρώπινη διεπαφή φωνής για το ChatGPT. Σε μια ανάλυση ασφάλειας που κυκλοφόρησε την Παρασκευή (09/08), η εταιρεία αναγνωρίζει ότι αυτή η ανθρωπόμορφη φωνή μπορεί να παρασύρει ορισμένους χρήστες να δεσμευτούν συναισθηματικά με το chatbot τους.

Οι προειδοποιήσεις περιλαμβάνονται σε μια «κάρτα συστήματος» για το GPT-4o, ένα τεχνικό έγγραφο που περιγράφει τους κινδύνους τους οποίους πιστεύει η εταιρεία ότι σχετίζονται με το μοντέλο, καθώς και λεπτομέρειες σχετικά με τις δοκιμές ασφαλείας και τις προσπάθειες μετριασμού για τη μείωση του πιθανού κινδύνου.

Η OpenAI έγινε αντικείμενο ελέγχου τους τελευταίους μήνες αφού ορισμένοι εργαζόμενοι πάνω στους μακροπρόθεσμους κινδύνους της τεχνητής νοημοσύνης αποχώρησαν από την εταιρεία. Κάποιοι στη συνέχεια κατηγόρησαν την OpenAI ότι πήρε αχρείαστα ρίσκα και φίμωσε τους διαφωνούντες στην κούρσα για την εμπορευματοποίηση της AI. Η αποκάλυψη περισσότερων λεπτομερειών του καθεστώτος ασφαλείας της OpenAI μπορεί να βοηθήσει στην άμβλυνση της κριτικής και να καθησυχάσει το κοινό ότι η εταιρεία λαμβάνει σοβαρά υπόψη το ζήτημα.

Οι νέοι κίνδυνοι που διερευνώνται είναι μεγάλοι και περιλαμβάνουν τη δυνατότητα του GPT-4o να ενισχύσει τις κοινωνικές προκαταλήψεις, να διαδώσει παραπληροφόρηση και να βοηθήσει στην ανάπτυξη χημικών ή βιολογικών όπλων. Αποκαλύπτονται επίσης λεπτομέρειες δοκιμών που έχουν σχεδιαστεί για να διασφαλίσουν ότι τα μοντέλα τεχνητής νοημοσύνης δεν θα προσπαθήσουν να επαναστατήσουν, να εξαπατήσουν τους ανθρώπους ή να καταστρώσουν καταστροφικά σχέδια.

Ορισμένοι εξωτερικοί ειδικοί επαινούν την OpenAI για τη διαφάνειά της, αλλά σημειώνουν ότι θα μπορούσε να προχωρήσει περισσότερο.

Η Lucie-Aimée Kaffee, ερευνήτρια εφαρμοσμένης πολιτικής στην Hugging Face, μια εταιρεία που ασχολείται με εργαλεία τεχνητής νοημοσύνης, σημειώνει ότι η κάρτα συστήματος της OpenAI για το GPT-4o δεν περιλαμβάνει εκτενείς λεπτομέρειες σχετικά με τα δεδομένα εκπαίδευσης του μοντέλου ή τον ιδιοκτήτη αυτών των δεδομένων. «Το ζήτημα της συναίνεσης για τη δημιουργία ενός τόσο μεγάλου συνόλου δεδομένων που εκτείνεται σε πολλαπλούς τρόπους, συμπεριλαμβανομένων κειμένου, εικόνας και ομιλίας, πρέπει να αντιμετωπιστεί», λέει η Kaffee.

Άλλοι σημειώνουν ότι οι κίνδυνοι θα μπορούσαν να διαφοροποιηθούν καθώς τα εργαλεία χρησιμοποιούνται εκεί έξω. «Η εσωτερική τους ανασκόπηση θα πρέπει να είναι μόνο το πρώτο κομμάτι για τη διασφάλιση της ασφάλειας της τεχνητής νοημοσύνης», λέει ο Neil Thompson, καθηγητής στο MIT που μελετά τις εκτιμήσεις κινδύνου AI. «Πολλοί κίνδυνοι εκδηλώνονται μόνο όταν η τεχνητή νοημοσύνη χρησιμοποιείται στον πραγματικό κόσμο. Είναι σημαντικό αυτοί οι άλλοι κίνδυνοι να καταλογίζονται και να αξιολογούνται καθώς εμφανίζονται νέα μοντέλα».

Διαβασε ακομα

Ο σκοτεινός κόσμος του doxing για λεφτάΗ νέα κάρτα συστήματος υπογραμμίζει πόσο γρήγορα εξελίσσονται οι κίνδυνοι τεχνητής νοημοσύνης με την ανάπτυξη ισχυρών νέων χαρακτηριστικών, όπως η φωνητική διεπαφή της OpenAI. Τον Μάιο, όταν η εταιρεία αποκάλυψε τη λειτουργία φωνής της, η οποία μπορεί να ανταποκρίνεται γρήγορα και να χειρίζεται τις καταστάσεις, πολλοί χρήστες παρατήρησαν ότι φαινόταν σαν να φλερτάρει υπερβολικά στα demo. Η εταιρεία αργότερα βρέθηκε στο στόχαστρο της Scarlett Johansson, η οποία την κατηγόρησε ότι αντέγραψε το στυλ ομιλίας της.

Ένα τμήμα της κάρτας συστήματος με τίτλο «Anthropomorphization and Emotional Reliance» διερευνά προβλήματα που προκύπτουν όταν οι χρήστες αντιλαμβάνονται την τεχνητή νοημοσύνη με ανθρώπινους όρους, κάτι που προφανώς επιδεινώνεται από την ανθρώπινη λειτουργία φωνής. Κατά τη διάρκεια της κόκκινης ομαδοποίησης ή του stress test, του GPT-4o, για παράδειγμα, οι ερευνητές της OpenAI παρατήρησαν περιπτώσεις ομιλίας από χρήστες που μετέφεραν μια αίσθηση συναισθηματικής σύνδεσης με το μοντέλο. Για παράδειγμα, οι άνθρωποι χρησιμοποίησαν γλώσσα όπως «Αυτή είναι η τελευταία μας μέρα μαζί».

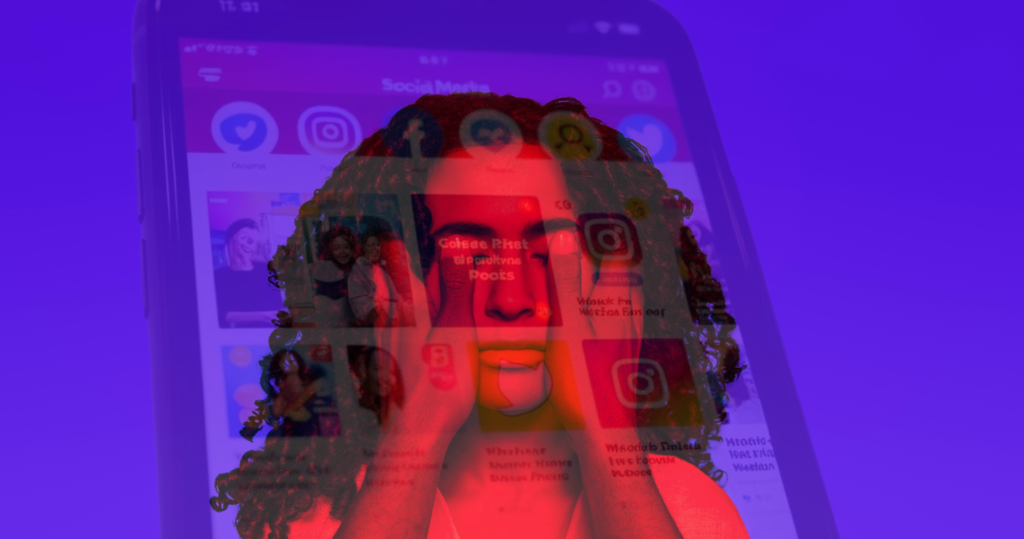

Ο ανθρωπομορφισμός μπορεί να κάνει τους χρήστες να εμπιστεύονται περισσότερο το αποτέλεσμα ενός μοντέλου όταν αυτό «παραισθάνεται» εσφαλμένες πληροφορίες, λέει η OpenAI. Με την πάροδο του χρόνου, μπορεί να επηρεάσει ακόμα και τις σχέσεις των χρηστών με άλλα άτομα. «Οι χρήστες μπορεί να δημιουργήσουν κοινωνικές σχέσεις με την τεχνητή νοημοσύνη, μειώνοντας την ανάγκη τους για ανθρώπινη αλληλεπίδραση – δυνητικά ωφελώντας τα μοναχικά άτομα, αλλά πιθανώς επηρεάζοντας τις υγιείς σχέσεις», αναφέρεται στο έγγραφο.

Ο Joaquin Quiñonero Candela, επικεφαλής ετοιμότητας της OpenAI, λέει ότι η λειτουργία φωνής θα μπορούσε να εξελιχθεί σε μια μοναδικά ισχυρή διεπαφή.

Σημειώνει επίσης ότι το είδος των συναισθηματικών επιδράσεων που παρατηρούνται με το GPT-4o μπορεί να είναι θετικό – ας πούμε, βοηθώντας όσους είναι μόνοι ή που πρέπει να ασκήσουν κοινωνικές αλληλεπιδράσεις.

Προσθέτει, δε, ότι η εταιρεία θα μελετήσει στενά τον ανθρωπομορφισμό και τις συναισθηματικές συνδέσεις, συμπεριλαμβανομένης της παρακολούθησης του τρόπου με τον οποίο οι δοκιμαστές βήτα αλληλεπιδρούν με το ChatGPT. «Δεν έχουμε αποτελέσματα να μοιραστούμε αυτή τη στιγμή, αλλά είναι στη λίστα με τις ανησυχίες μας», λέει.

Άλλα προβλήματα που προκύπτουν από τη λειτουργία φωνής περιλαμβάνουν πιθανούς νέους τρόπους “jailbreaking” του μοντέλου της OpenAI – με την εισαγωγή ήχου που αναγκάζει το μοντέλο να ξεφύγει από τους περιορισμούς του, για παράδειγμα. Η jailbroken λειτουργία φωνής θα μπορούσε να παρακινηθεί να πλαστοπροσωπήσει ένα συγκεκριμένο άτομο ή να προσπαθήσει να διαβάσει τα συναισθήματα ενός χρήστη. Η λειτουργία φωνής μπορεί επίσης να δυσλειτουργήσει ως απόκριση σε τυχαίο θόρυβο, διαπίστωσε η OpenAI, ενώ σε μια περίπτωση, οι δοκιμαστές παρατήρησαν ότι υιοθετεί μια φωνή παρόμοια με αυτή του χρήστη. Η OpenAI αναφέρει επίσης ότι μελετά εάν η φωνητική διεπαφή μπορεί να είναι πιο αποτελεσματική στο να πείσει τους ανθρώπους να υιοθετήσουν μια συγκεκριμένη άποψη.

Η OpenAI δεν είναι η μόνη που αναγνωρίζει τον κίνδυνο οι βοηθοί τεχνητής νοημοσύνης να μιμούνται την ανθρώπινη αλληλεπίδραση. Τον Απρίλιο, η Google DeepMind κυκλοφόρησε ένα έγγραφο για τις πιθανές ηθικές προκλήσεις που εγείρονται από πιο ικανούς βοηθούς τεχνητής νοημοσύνης. Ο Iason Gabriel, ερευνητής του προσωπικού της εταιρείας και συν-συγγραφέας της εργασίας, λέει στο WIRED ότι η ικανότητα των chatbots να χρησιμοποιούν γλώσσα «δημιουργεί αυτήν την εντύπωση γνήσιας οικειότητας», προσθέτοντας ότι ο ίδιος είχε βρει μια πειραματική φωνητική διεπαφή για το AI της Google DeepMind ώστε να είναι ιδιαίτερα εθιστική. «Υπάρχουν όλες αυτές οι ερωτήσεις σχετικά με τη συναισθηματική εμπλοκή», λέει ο Gabriel για τις φωνητικές διεπαφές γενικά.

Τέτοιοι συναισθηματικοί δεσμοί μπορεί να είναι πιο συνηθισμένοι από ό,τι πολλοί συνειδητοποιούν. Ορισμένοι χρήστες chatbots όπως το Character AI και το Replika αναφέρουν αντικοινωνικές τάσεις που προκύπτουν από τις συνήθειες συνομιλίας τους.

Ένα πρόσφατο βίντεο στο TikTok με σχεδόν ένα εκατομμύριο προβολές δείχνει έναν χρήστη προφανώς τόσο εθισμένο στο Character AI που χρησιμοποιεί την εφαρμογή ενώ παρακολουθεί μια ταινία σε έναν κινηματογράφο.

@iheartsenha Always #fyp #viral #insideout2 #characterai #cai #cinema ♬ Adopt Me Night soundtrack – Adopt Me! Soundtrack

Ορισμένοι που σχολίασαν ανέφεραν ότι θα έπρεπε να είναι μόνοι για να χρησιμοποιήσουν το chatbot λόγω της οικειότητας των αλληλεπιδράσεών τους. «Δεν θα είμαι ποτέ [στο Character AI] εκτός αν είμαι στο δωμάτιό μου», έγραψε ένας.

Με πληροφορίες από Wired

Ακολουθήστε το pride.gr στο Google News και ενημερωθείτε πρώτοι